在物流仓库或现代化工厂,你常会看到这样的场景:机械臂精准地伸向堆叠如山的纸箱、料箱,甚至软包,轻松抓取并放到传送带上,整个过程行云流水,无需人工干预。让机器人从“盲人摸象”到“火眼金睛”的秘诀,就是3D视觉引导技术。

很多入门者会好奇,这双“眼睛”究竟如何看清货物、精准定位,又能无缝指挥机器人完成动作?本文将拆解3D视觉“扫描识别-坐标定位-机器人联动”的完整流程,讲透点云数据采集、货物轮廓提取与姿态判断的核心逻辑,结合纸箱、托盘、料箱等常见物料的特性,帮大家轻松理解3D视觉拆码垛的底层原理。

一、先搞懂核心:“机器眼”到底在做什么?

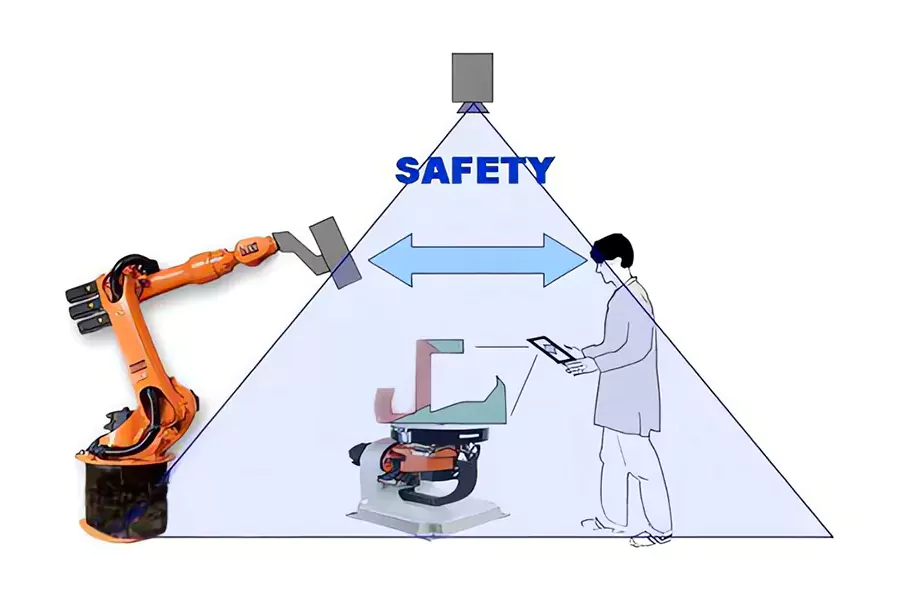

简单来说,3D视觉系统的核心作用,就是帮机器人“看清”工作区域的货物——包括货物的位置、形状、摆放角度,甚至是是否有变形、粘连等情况,再把这些信息转化为机器人能听懂的指令,引导机器人精准抓取、搬运、码放,全程无需人工干预。和传统机器人按预设程序干活不同,3D视觉让机器人有了自主判断的能力,哪怕货物摆放不规整、品规多样,也能灵活应对,这也是它能适配多场景拆码垛的关键优势,尤其在食品、医药、电商等物料品类复杂的行业,应用格外广泛。

二、全流程拆解:“机器眼”指挥机器人搬货的3步走

3D视觉引导拆码垛的核心流程,可简化为“扫描识别-坐标定位-机器人联动”三步,每一步都有明确的分工,环环相扣,确保搬运精准高效。

第一步:扫描识别——给货物拍“3D全身照”,收集核心数据

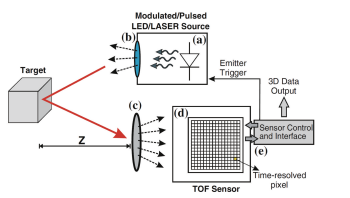

这一步就像我们用眼睛观察物体, 3D相机会对托盘上的货物进行全方位扫描,不过它拍的不是普通的平面照片,而是能呈现货物立体形态的“3D数据”——也就是行业里常说的“点云数据”。

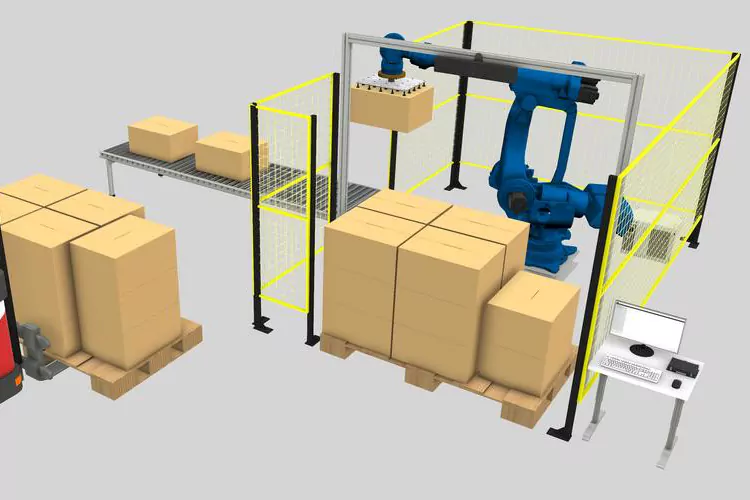

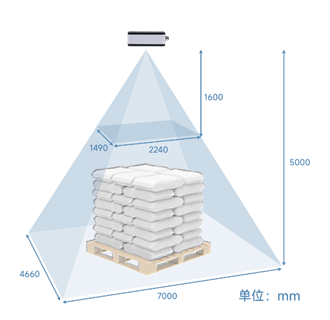

点云数据可以理解为“无数个微小的3D坐标点”,这些点密密麻麻覆盖在货物表面,拼凑出货物的立体轮廓,就像用无数个小积木搭出货物的样子。3D相机的安装方式主要有两种:一种是固定在托盘上方,称为“眼在外”,适合大面积扫描整垛货物;另一种是安装在机器人手臂上,跟着手臂一起移动,称为“眼在手”,能灵活调整拍摄角度,兼顾不同高度货物的识别精度,尤其适合电商仓库中料箱垛高不一的场景。

采集点云数据时,3D相机会自动应对不同物料的特性:比如纸箱表面可能有图案、褶皱或扎带,麻袋容易变形、松散,料箱可能壁薄、紧密嵌合,甚至部分物料会有反光(如金属材质、透明膜包)。针对这些情况,相机通过多光谱补光、抗干扰算法等技术,修复反光区域的缺失数据,确保收集到的点云数据清晰、完整,为后续识别打下基础。

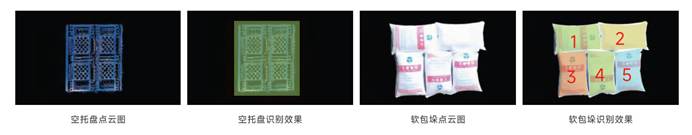

其中软包的扫描的难度更高,因形态不固定、垛型杂乱(如六花垛),需要更精准的点云采集技术,捕捉其变形后的真实轮廓。值得一提的是,洛微科技的方案在这一环节表现突出,不仅能精准应对六花垛、回形垛等不规则码放方式,还具备出色的恶劣工况适应能力,可在粉尘、油污等工业环境中稳定工作,无需人工频繁清理维护,既保证了数据采集的准确性,也减少了人工在恶劣环境下作业的健康风险,这与其产品具备IP67工业级防水防尘、超强抗干扰能力的特性密不可分。

第二步:坐标定位——分析数据,确定“抓哪里、怎么抓”

收集到点云数据后,3D视觉系统会像大脑一样,对数据进行处理,核心完成两件事:提取货物轮廓、判断货物姿态,最终转化为机器人能识别的三维坐标。

首先是货物轮廓提取:系统会从海量点云数据中,筛选出属于货物的点,剔除托盘、地面等无关信息,精准勾勒出单个货物的立体轮廓——比如纸箱是长方体、料箱有特定的边角结构,哪怕货物有轻微变形、粘连,也能通过实例分割算法(如Mask R-CNN),精准区分单个货物,避免抓取时误抓多个或抓空。这种算法就像给每个货物“画专属轮廓线”,哪怕多个货物紧密贴合,也能清晰区分边界。

其次是姿态判断:这是确保抓取稳定的关键。系统会通过算法分析货物的摆放角度,比如纸箱是正放、侧放还是倾斜,料箱是否嵌合,最终确定货物的四维位姿——也就是三维空间坐标(X、Y、Z,对应前后、左右、上下位置)和旋转角度(R,对应货物的摆放方向)。这个过程就像我们拿起一个倾斜的盒子前,会先判断它的角度,再调整手势,确保抓得稳。

这里还要完成一个关键步骤:坐标转换。因为3D相机的视野坐标系和机器人的动作坐标系不一样,系统需要通过手眼标定,建立两者的转换关系,把货物在相机视野里的坐标,转化为机器人手臂能精准到达的坐标,相当于给机器人“校准方向”,避免出现“看得到、够不着”或“抓不准”的情况。

第三步:机器人联动——接收指令,完成拆码垛动作

当3D相机完成扫描和定位,就会把处理好的坐标、姿态信息,以指令的形式发送给机器人。机器人接到指令后,会根据货物特性调整抓取策略:比如抓取纸箱时,会选择平整的侧面或顶面,避免捏变形;抓取易变形的麻袋时,会调整夹具力度,确保稳固;抓取紧密嵌合的料箱时,会规划避障路径,避免碰撞。

拆垛时,系统会自动规划最优抓取顺序,优先抓取顶层货物,避免干扰下层货物;码垛时,会根据预设的垛型(或自动生成垛型),引导机器人将货物整齐摆放,甚至支持多品类混码、半垛续码,提升托盘利用率。整个过程中,系统还会实时进行碰撞检测,规避抓取、搬运过程中的干涉风险,确保动作安全稳定。

三、核心逻辑简化:不用懂技术,也能get关键要点

很多入门者看到“点云数据”“姿态判断”“坐标转换”会觉得复杂,其实我们可以用通俗的方式理解这三个核心逻辑,结合常见物料特性更易上手:

- 点云数据采集:相当于给货物扫一遍全身,不管是纸箱、料箱还是托盘,都能通过无数个3D点,还原它的真实大小和形状,哪怕有反光、变形也能精准捕捉,这是看清货物的基础;

- 货物轮廓提取:相当于从一堆货物中,挑出单个货物,画出它的轮廓,区分开货物和托盘、货物和货物,解决分不清哪个是哪个的问题,尤其适合混码垛场景;

- 姿态判断:相当于判断货物躺得正不正、歪了多少,再告诉机器人从哪个角度抓最稳,比如纸箱倾斜时,机器人会调整手臂角度,避免抓取时滑落,适配不同物料的抓取需求。

四、常见物料适配:不同货物,“机器眼”如何针对性应对?

3D视觉拆码垛的优势的之一,就是能适配多种常见物料,针对不同物料的特性,系统会调整识别和抓取策略,具体可以参考以下常见场景:

1. 纸箱:最常见的拆码垛物料,表面可能有图案、扎带或褶皱,系统通过实例分割算法精准提取轮廓,忽略表面无关纹理,抓取时优先选择平整区域,避免捏压变形,同时支持多品规纸箱混拆混码;

2. 料箱(周转箱):常出现壁薄、紧密嵌合、箱内工件反光等问题,系统通过高精度点云采集和抗反光算法,清晰识别箱口位置,规划拖拽式抓取路径,避免嵌合时无法抓取,适配多种品规料箱的中转搬运;

3. 软包(麻袋/蛇皮袋):核心难点在于形态不固定,易产生褶皱、变形,且通常垛型混乱(如六花垛),识别和抓取难度较高。技术对策是引入AI深度学习算法,专门识别袋状物特征,即便软包严重变形,也能精准计算出重心偏上的最佳抓取点,同时配合专用吸盘或力控夹具,精准控制抓取力度,实现“零破损”抓取,适配六花垛等复杂垛型的拆码垛需求。

4. 托盘:作为货物的承载工具,系统会先识别托盘的位置和尺寸,避开托盘边缘,确保机器人抓取货物时不碰撞托盘,同时根据托盘尺寸规划码垛密度,提升空间利用率;

5. 特殊物料:比如易变形的麻袋、透明膜包、高反光的金属锭等,系统通过深度学习算法和特殊补光技术,应对变形、反光等问题,麻袋拆垛可适配五花垛、交叉垛等多种垛型,透明膜包则通过增强点云对比度,确保轮廓清晰。

五、总结

其实3D视觉引导拆码垛的核心逻辑很简单:用3D相机扫描货物、收集立体数据,再通过算法处理数据、确定货物的位置和姿态,最后给机器人发指令,完成精准拆码垛。它的优势在于柔性化——不用预设程序,能应对不同品规、不同摆放状态的货物,解决传统机器人死板的问题。随着ToF传感器成本的下降和深度学习算法的迭代,这项技术正在从“可选”变为“必选”,成为智能制造和智慧物流的基础设施。无论你是关注视觉引导拆垛机器人技术的工程师,还是正在寻求自动化升级的仓库管理者,希望这篇文章能对你有所帮助。